Chat GPTが世に登場し、そのことをブログに書いたのが今からおよそ3年前。

そこからしばらくはクラウド型のLLM(大規模言語モデル)が主流でしたが、現在ではローカルで稼働できるモデルもいよいよ実用レベルになってきています。

今回はそのLLMを動かせるツールとして「LM Studio」を実際に試してみました。

そもそもなぜローカルLLM?(メリットとデメリット)

ローカルLLMには、クラウドベースのLLM(Chat GPTやGeminiなど)とは異なる点がいくつかあります。

ローカルLLMのメリット

| オフラインで利用可能 | ネットワーク接続不要。 ネット環境が不安定な場所でも使える。 |

| 運用コストゼロ | クラウドAPIの料金やデータ転送費が発生しない。 |

| セキュリティ・プライバシー保護 | データを外部に送らず内部で完結するため、 情報漏洩リスクがほとんどない。 |

| 制限なし | クラウドサービスでは 「1日あたりのトークン数」や「使用回数」に上限があるが、 ローカルなら無制限に質問できる。 |

ローカルLLMのデメリット

| 最新情報へのアクセス不可 | ほとんどのローカルモデルは 半年前くらいのトレーニングデータで構築されている。 |

| ハードウェア依存 | 高精度モデル(12B, 27Bなど)は CPU・RAM・GPUに高スペックが要求される。 |

私のようにブログ記事の校正・リライトのような使い方であれば、デメリットはほぼ打ち消されます。

特に、最新情報は問わず普遍的回答を求める場合にはメリットのほうが大きいでしょう。

もちろんデータ・技術面ともに半年~1年くらい前の水準ですから、「できるかぎり新しく精度の高い回答がほしい」というユーザーには逆に不向きともいえます。

アプリの選択とインストール

ローカルLLMを実行するには、ローカルでAIを動かすアプリケーションが必要になります。

その代表格に位置するのが「Ollama」と「LM Studio」。

Ollamaはカスタマイズ性が高く、開発者やプログラマー向けです。

LM Studioはクラウド型のChat GPTやGeminiと同等に扱いやすいUIで、設定もシンプル。ライトユーザ向けです。![]()

Ollamaのほうが若干人気は高そうですが、ライトユーザーの私は迷わずLM Studioをチョイスしました。

LM Studioのダウンロードとインストールは、パソコンのアプリと同じ感覚で進めることができます。

ディベロッパー・モードを採用するか否かの選択のところ、私はプログラマーでもエンジニアでもありませんからもちろん”否”。(あとからでも変更は可。)

UIの使用感とモデルの選択

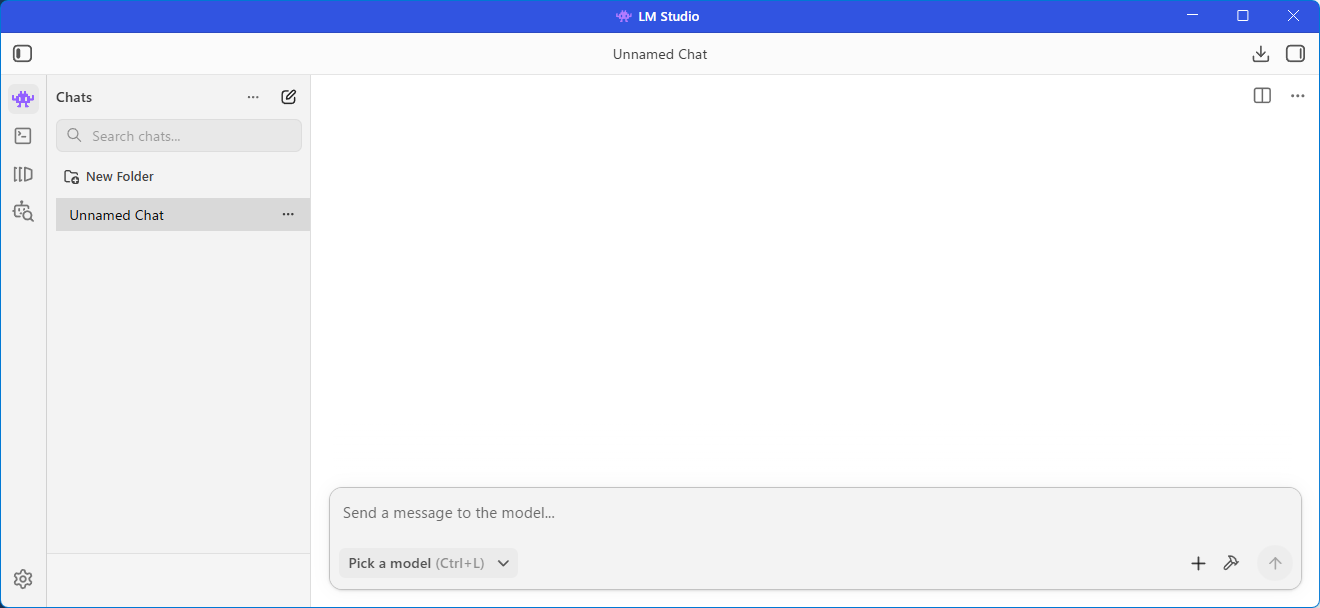

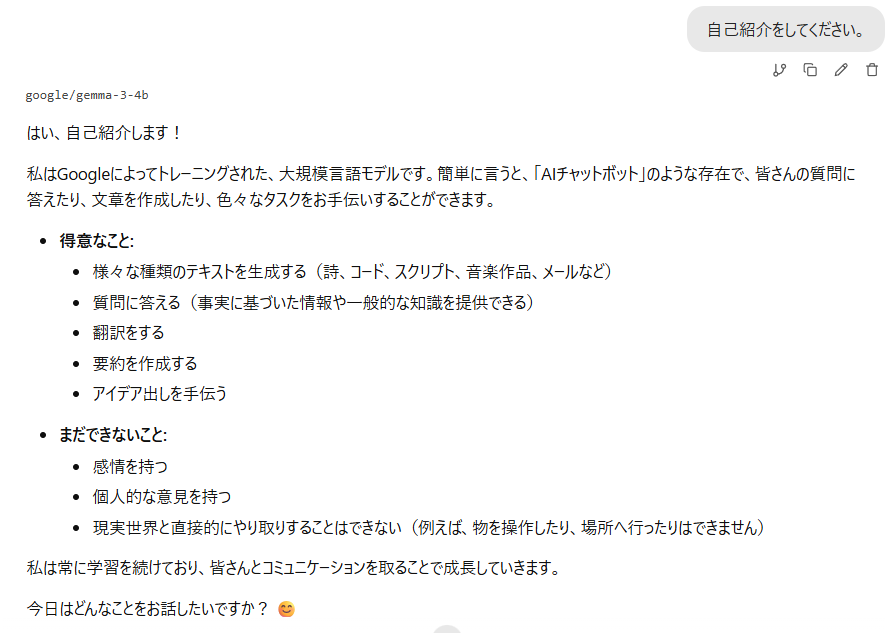

LM Studioを起動すると、Chat GPTやGeminiのようなUIが表示されます。

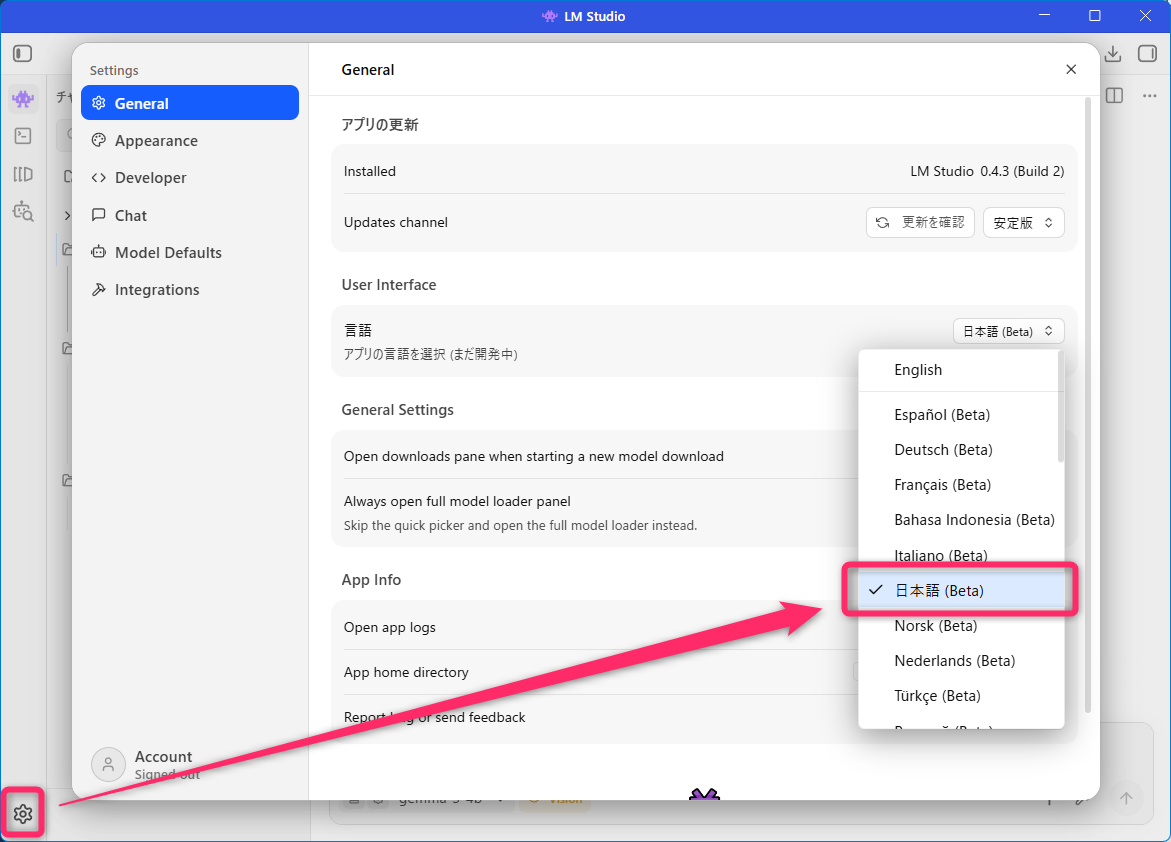

まず左下の歯車から、言語を日本語にしておく。

チャット画面の見た目はシンプルで、ライトユーザーにも優しいのが分かります。

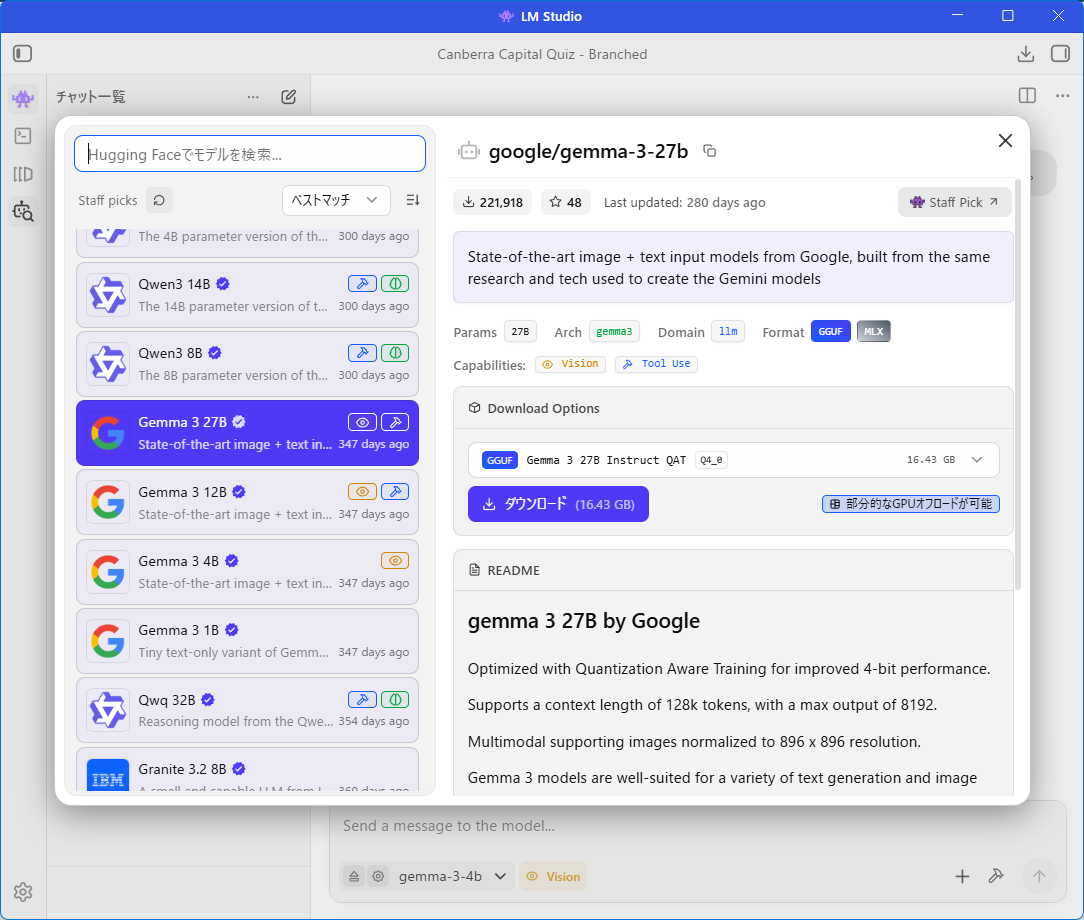

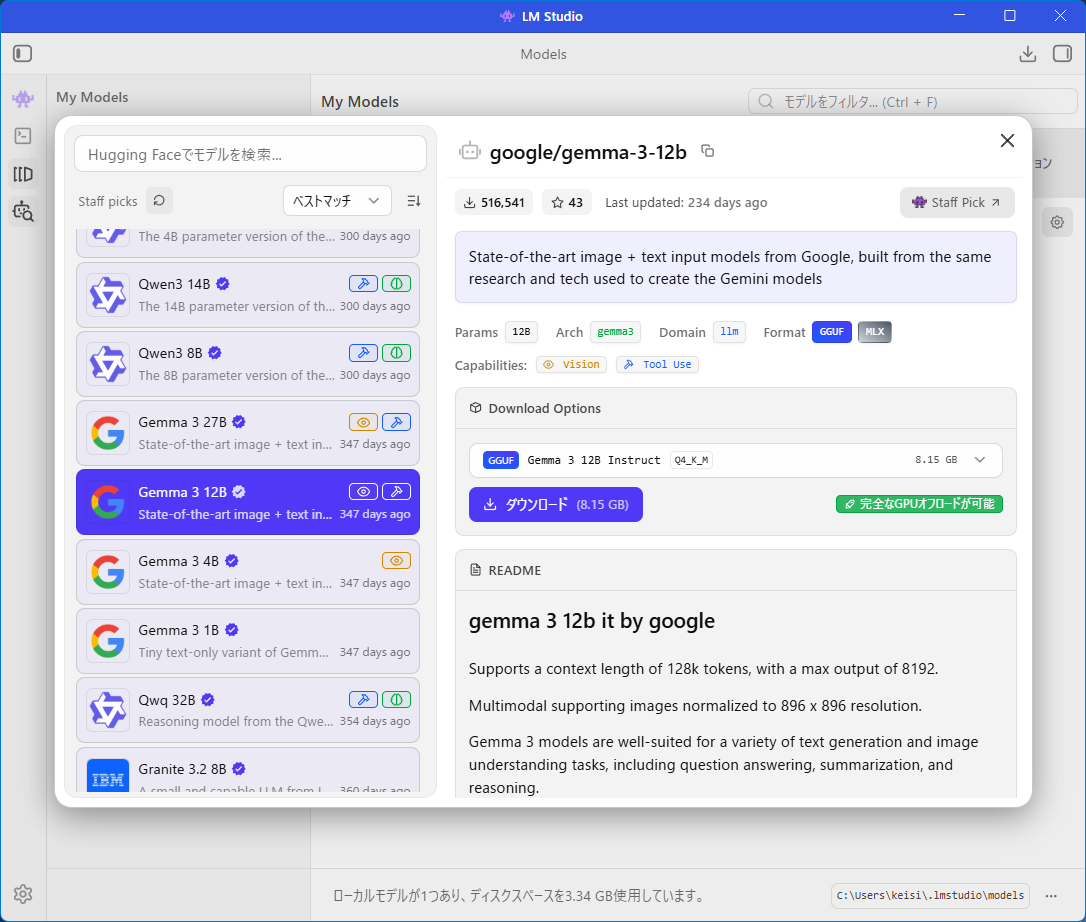

クラウド型とのちがいは、ここから自分のパソコンに適した言語モデルをダウンロードするという点。

情報量の多い言語モデルほどパソコンへの負担が大きくなるため、最適なバランスを見つける必要があります。

検証に使用するパソコンは、おおよそミドルレンジくらい(中程度)の性能です。(↓)

| CPU | Core i5‑14400F |

| RAM | 32 GB |

| GPU | RTX 3060(12GB) |

Gemma 3

まずはGoogleが提供する「Gemma 3」という言語モデルから試してみました。

扱い方はChat GPTと同じ。

デフォルトの「Gemma 3 4B」はわりと軽い言語モデルなので、回答が即座に返ってきます。(※4B=40億パラメータ)

次に、ハードウェアの限界を探ろうと、パラメータのいちばん大きい「Gemma 3 27B」もいちおう試してみました。

明らかに精度が上がったものの、表示速度はかなりスローで、回答中はRAM・VRAMとも常時90パーセント超え。パソコンにかなり無理をさせている感じです。

そして最終的に、私のパソコンの性能では「Gemma 3 12B」あたりが 精度と速度のいちばんバランスが取れたモデルであることが分かりました。

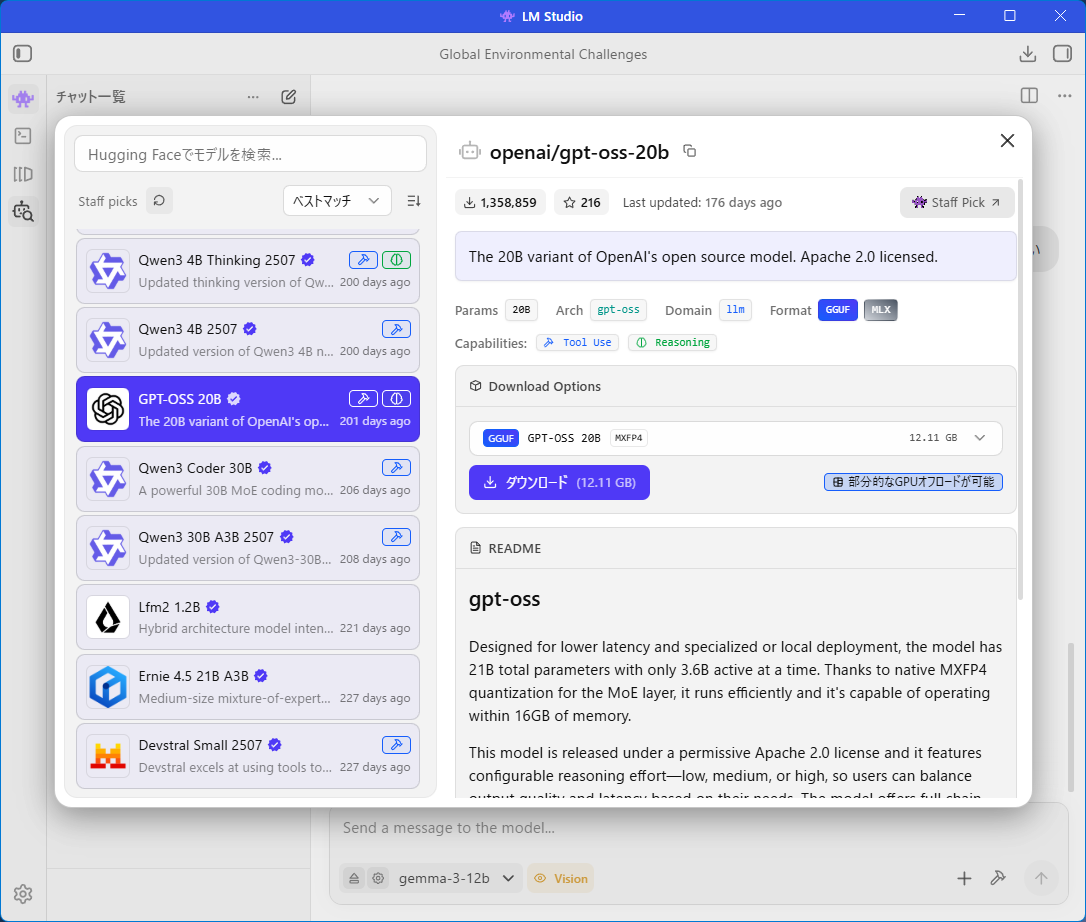

gpt-oss 20B

次はChat GPTのOpenAI社が手掛ける「gpt-oss 20B」を使ってみました。

チャットをしてみたところ返答はわりと速く、プロンプト次第ではかなり高精度の回答が返ってきます。

質問を2、3回投げかけた程度ですから、あくまで体感です。

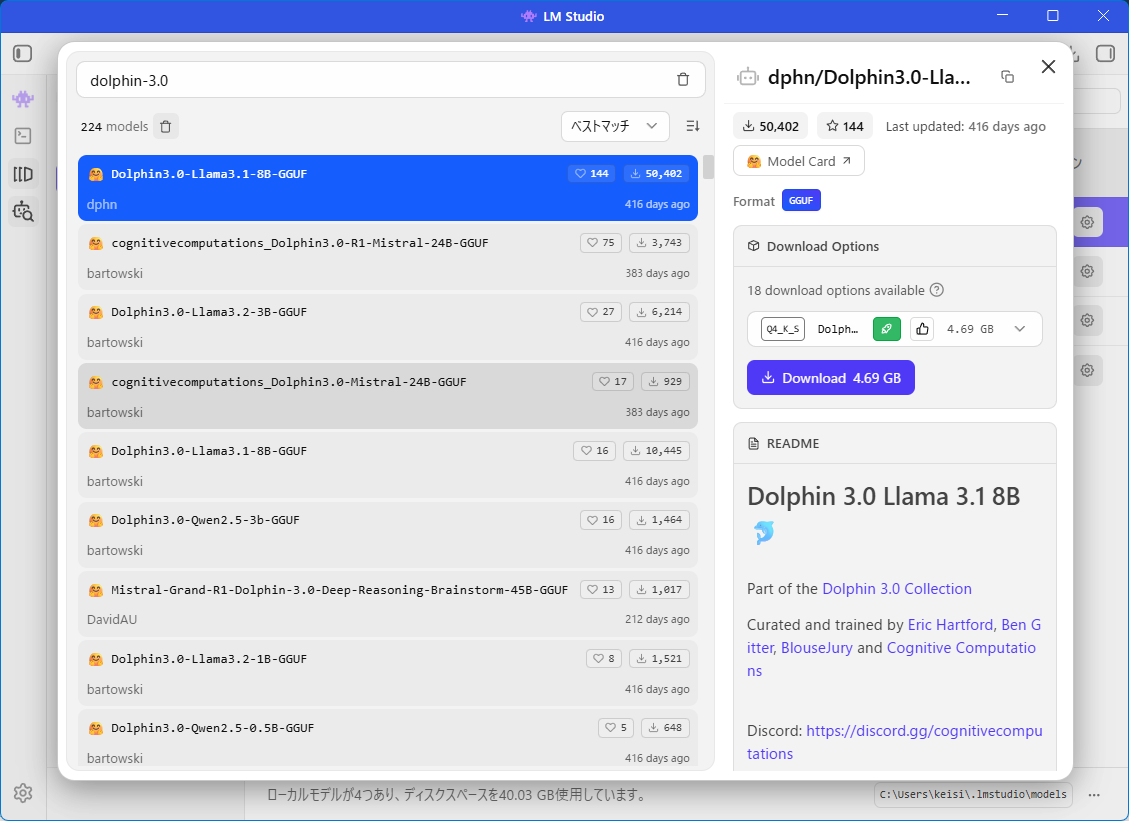

Dolphin 3

あとは気になったモデルで、情報の制限(検閲)フリーの「Dolphin 3」。

文章が煩雑かつ稚拙で、あとは誤字もチラホラ。

日本語の文章を目的とするならば、こちらは完全にアウトでした。(日本語への対応が不完全ってこと。)

ざっと使ってみた感じ、私と同程度のパソコンを使っているかたはやはり「Gemma 3 12B」あたりを使うのが妥当だと思う。

まとめ:ローカルLLMは試してみる価値あり!

今回の試用を通して、ローカルLLMは問題なく”使える”ツールだと分かりました。

クラウドベースのLLMとは異なり、無制限に利用できる点と、情報漏洩を気にせず使える点が大きな魅力です。

おそらく今後も進化し続ける分野ですから、特にGhat GPUやGeminiの無料版ユーザーのかたは、今からでも試してみる価値アリです。(おわり)